flask+seq2seq实现聊天机器人在线群聊

徐静 硕士研究生、算法工程师 、Python爱好者社区专栏作者

兴趣方向:统计机器学习,深度学习,模型的线上化部署、网络爬虫,前端可视化。

个人博客 : https:// dataxujing.github.io/

在大多数标准中,Flask都算是小型框架,小到可以称为“微框架”,所以你一旦熟悉使用它,很可能就能读懂他所有的源码,本项目是自己线下玩的项目,因此采用了Flask这种小而功能比较全的框架。

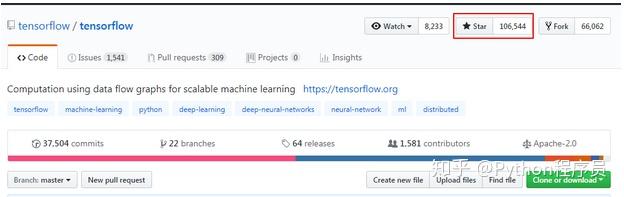

TensorFlow是Google于2015年11月9日正式开源的深度学习框架,提供了海量的深度学习模型的API,可以快速的实现深度学习模型的搭建。目前在GitHub上的star也是惊人:

基于Python的TnesoFlow接口,训练seq2seq模型用于娱乐性的聊天机器人场景。 Seq2Seq被提出于2014年,最早由两篇文章独立地阐述了它主要思想,分别是Google Brain团队的《Sequence to Sequence Learning with Neural Networks》和Yoshua Bengio团队的《Learning Phrase Representation using RNN Encoder-Decoder for Statistical Machine Translation》。这两篇文章针对机器翻译的问题不谋而合地提出了相似的解决思路,Seq2Seq由此产生。Seq2Seq解决问题的主要思路是通过深度神经网络模型(常用的是LSTM,GRU)将一个作为输入的序列映射为一个作为输出的序列,这一过程由编码(Encoder)输入与解码(Decoder)输出两个环节组成, 前者负责把序列编码成一个固定长度的向量,这个向量作为输入传给后者,输出可变长度的向量。详细介绍可参见: https:// dataxujing.github.io/se q2seqlearn/

首先我们基于问答语料库去训练我们的seq2seq聊天机器人系统,其核心算法主要如下:

```python def getmodel(feedprevious=False): """ 构造模型:seq2seq feed_previous表示decoderinputs是我们直接提供训练数据的输入, 还是用前一个RNNCell的输出映射出来的,如果feedprevious为True, 那么就是用前一个RNNCell的输出,并经过Wx+b线性变换 """

learning_rate = tf.Variable(float(init_learning_rate), trainable=False, dtype=tf.float32)

learning_rate_decay_op = learning_rate.assign(learning_rate * 0.9)

encoder_inputs = []

decoder_inputs = []

target_weights = []

for i in range(input_seq_len):

encoder_inputs.append(tf.placeholder(tf.int32, shape=[None], name="encoder{0}".format(i)))

for i in range(output_seq_len + 1):

decoder_inputs.append(tf.placeholder(tf.int32, shape=[None], name="decoder{0}".format(i)))

for i in range(output_seq_len):

target_weights.append(tf.placeholder(tf.float32, shape=[None], name="weight{0}".format(i)))

# decoder_inputs左移一个时序作为targets

targets = [decoder_inputs[i + 1] for i in range(output_seq_len)]

cell = tf.contrib.rnn.BasicLSTMCell(size)

# 这里输出的状态我们不需要

outputs, _ = seq2seq.embedding_attention_seq2seq(

encoder_inputs,

decoder_inputs[:output_seq_len],

cell,

num_encoder_symbols=num_encoder_symbols,

num_decoder_symbols=num_decoder_symbols,

embedding_size=size,

output_projection=None,

feed_previous=feed_previous,

dtype=tf.float32)

# 计算加权交叉熵损失

loss = seq2seq.sequence_loss(outputs, targets, target_weights)

# 梯度下降优化器

opt = tf.train.GradientDescentOptimizer(learning_rate)

# 优化目标:让loss最小化

update = opt.apply_gradients(opt.compute_gradients(loss))